Explorando la percepción y la interacción de los robots con su entorno físico a través de la IA espacial

Los técnicos del Instituto Tecnológico de Massachusetts (MIT) están esforzándose en potenciar a los robots para que procesen y ejerzan comandos de alto rango, como localizar un objeto en una estancia diferente y traerlo para un usuario. Para lograr tal nivel de autonomía, los robots han de ser capaces de interpretar sus entornos físicos de forma parecida a como lo hacemos nosotros, los humanos.[automatic_youtube_gallery type="search" search="El progreso en la ‘Inteligencia Artificial Espacial’ permite a los robots percibir entornos físicos como un ser humano" cache="2419200" per_page="1" thumb_excerpt="0" player_description="0"]

Luca Carlone es profesor asistente de aeronáutica y astronáutica en el MIT.

“Para tomar cualquier decisión en el mundo, debes tener un modelo mental del entorno que te rodea”, comenta Carlone. “Eso es algo que los humanos hacemos sin esfuerzo. Para los robots, sin embargo, la transformación de datos visuales captados por una cámara en una comprensión coherente del entorno es un gran desafío”.

Con objeto de superar este desafío, el equipo de investigación ha modelado una representación de la percepción espacial para robots fundamentada en cómo los humanos perciben y se desplazan en sus entornos físicos.

Implementando gráficos dinámicos 3D de escena

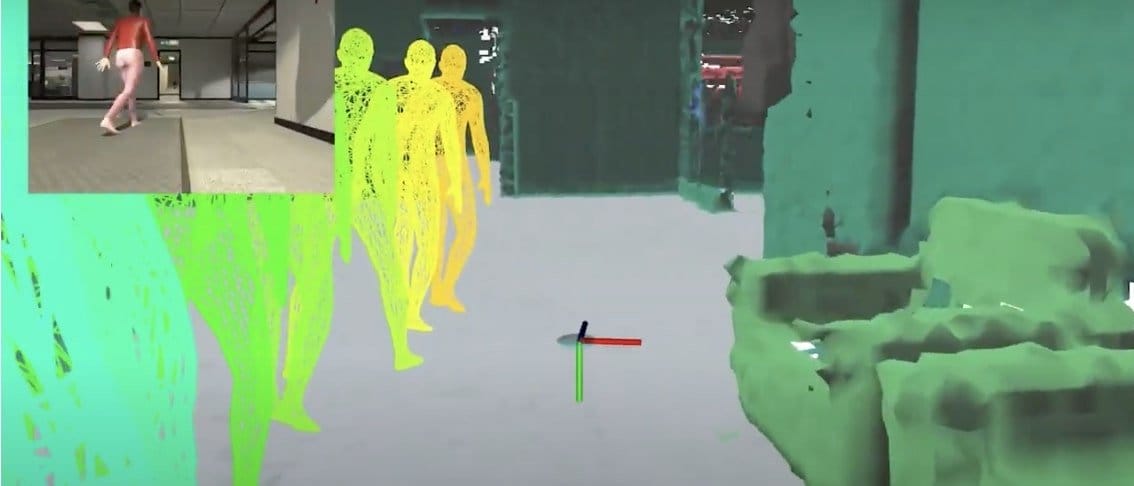

El novedoso modelo es conocido como Gráficos Dinámicos de Escena 3D y permite a un robot generar un mapa 3D del entorno físico en el que está, etiquetando objetos y otros elementos de interés. El robot también puede mapear personas, habitaciones, paredes y otras estructuras de su entorno.

Posteriormente, el modelo posibilita que el robot extraiga información del mapa 3D, información que puede emplearse para detectar objetos, habitaciones y el movimiento de personas.

«Esta representación comprimida del entorno es útil porque permite a nuestro robot tomar decisiones rápidamente y planificar su ruta», afirma Carlone. “Esta es la misma técnica que utilizamos nosotros como humanos. Si necesitas planificar un camino desde tu casa hasta el MIT, no planificas cada paso. Simplemente priorizas calles y puntos de referencia, lo que te ayuda a planificar tu ruta más rápidamente”.

Según Carlone, los robots que usen este modelo podrían desempeñarse en muchas más labores que solo tareas domésticas. Podrían ser útiles para adquirir habilidades de alto nivel y trabajar junto a personas en fábricas, o ayudar a localizar a los sobrevivientes en un lugar de desastre.

Comparativo entre métodos actuales y nuevo modelo

Los métodos actuales de visión y navegación robótica se centran principalmente en el mapeo 3D que permite a los robots reconstruir su entorno en tres dimensiones en tiempo real, o segmentación semántica, que ocurre cuando los robots clasifican características del entorno como objetos semánticos, como un automóvil versus un bicicleta. La segmentación semántica suele realizarse en imágenes 2D.

El modelo de percepción espacial recientemente desarrollado es el primero de su tipo en generar un mapa 3D del entorno en tiempo real y etiquetar objetos, personas y estructuras dentro del mapa 3D al mismo tiempo.

Para poner en marcha este nuevo modelo, los investigadores confiaron en Kimera, una biblioteca de código abierto. Kimera fue desarrollada previamente por el mismo equipo para construir un modelo geométrico 3D de un entorno, mientras que al mismo tiempo codifica cuál es el objeto probable, como una silla versus un escritorio.

«Al igual que la criatura mítica que es una mezcla de diferentes animales, queríamos que Kimera fuera una mezcla de mapeo y comprensión semántica en 3D», cuenta Carlone.

Kimera utilizó imágenes de la cámara de un robot y mediciones inerciales de sensores integrados para reconstruir la escena como una malla 3D en tiempo real. Para hacer esto, Kimera utilizó una red neuronal que ha sido entrenada en millones de imágenes del mundo real para poder predecir la etiqueta de cada píxel y utilizar la proyección de rayos para proyectarlos en 3D.

Mediante el uso de esta técnica, el entorno del robot se puede mapear en una malla tridimensional donde cada cara está codificada por colores, identificándola como parte de objetos, estructuras o personas en el entorno.

Transformando una malla 3D a ‘gráficos de escena’ dinámicos 3D

Debido a que el modelo de malla semántica 3D requiere mucha potencia computacional y consume mucho tiempo, los investigadores utilizaron Kimera para desarrollar algoritmos que dieron como resultado “gráficos de escena” dinámicos 3D.

La malla semántica 3D se divide en distintas capas semánticas y luego el robot puede ver una escena a través de una capa. Las capas van desde objetos y personas hasta espacios y estructuras abiertas, habitaciones, pasillos, vestíbulos y edificios completos.

Este enfoque basado en capas permite al robot limitar su enfoque en lugar de tener que analizar miles de millones de puntos y caras. Este enfoque basado en capas también permite a los algoritmos rastrear a los humanos y su movimiento dentro del entorno en tiempo real.

El nuevo modelo se probó en un simulador fotorrealista que simula un robot que navega en un entorno de oficina con personas en movimiento.

«Básicamente, estamos permitiendo que los robots tengan modelos mentales similares a los que usan los humanos», añade Carlone. “Esto puede afectar a muchas aplicaciones, incluidos los vehículos autónomos, la búsqueda y rescate, la fabricación colaborativa y la robótica doméstica.

Carlone ha trabajado junto con el autor principal y estudiante graduado del MIT Antoni Rosinol.

«Nuestro enfoque acaba de ser posible gracias a avances recientes en aprendizaje profundo y décadas de investigación sobre localización y mapeo simultáneos«, apunta Rosinol. «Con este trabajo, estamos dando el salto hacia una nueva era de percepción robótica llamada IA espacial, que está apenas en su infancia pero tiene un gran potencial en robótica y realidad virtual y aumentada a gran escala».

La investigación fue presentada en la Conferencia virtual de Robótica: Ciencia y Sistemas.